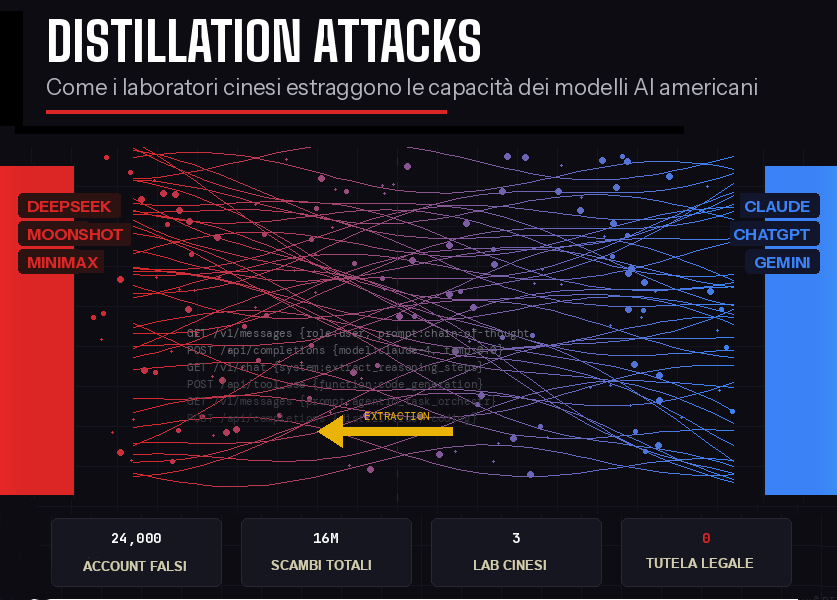

Oggi, 24 febbraio 2026, Anthropic ha pubblicato un report esplosivo: tre laboratori cinesi, DeepSeek, Moonshot AI e MiniMax, hanno condotto campagne di distillazione su scala industriale contro Claude.

I numeri fanno impressione: 24.000 account fraudolenti, 16 milioni di scambi con il modello. Non stiamo parlando di qualcuno che copia-incolla qualche risposta, ma di un’operazione sistematica e coordinata per estrarre le capacità di ragionamento, coding e uso di strumenti di uno dei modelli più avanzati al mondo.

Due settimane fa, OpenAI aveva denunciato la stessa cosa al Congresso americano riguardo a ChatGPT e Google ha segnalato oltre 100.000 prompt mirati su Gemini.

Il pattern è chiaro: i tre principali modelli americani sono sotto attacco simultaneo.

Come funziona la distillazione (in parole semplici)

La distillazione è una tecnica nota nell’AI: prendi un modello grande e potente (il “maestro”), gli fai migliaia di domande mirate, e usi le sue risposte per addestrare un modello più piccolo ed economico (lo “studente”).

Lo studente impara a imitare il maestro senza aver mai visto i dati originali di addestramento.

Geniale.

Le aziende AI la usano legittimamente tutti i giorni: Anthropic distilla Claude Opus per creare Claude Haiku, OpenAI distilla GPT-4 per creare GPT-4-mini.

È una pratica standard, ma il problema nasce quando un concorrente usa questa tecnica sui tuoi modelli, aggirando le restrizioni geografiche con servizi proxy, creando migliaia di account falsi, e generando milioni di query progettate per estrarre le capacità più avanzate. In sostanza: anni di ricerca e miliardi di dollari di investimento vengono compressi in poche settimane di scraping automatizzato.

I numeri dell’operazione

Secondo il report di Anthropic:

– DeepSeek: 150.000 scambi mirati su ragionamento logico e allineamento

– Moonshot AI: 3,4 milioni di scambi su ragionamento agentico, coding e computer vision (il loro modello Kimi K2.5, rilasciato il mese scorso, ne è probabilmente il risultato)

– MiniMax: 13 milioni di scambi su coding agentico e orchestrazione di strumenti

— Anthropic li ha colti in flagrante: quando è uscito un nuovo modello Claude, MiniMax ha rediretto metà del traffico nel giro di 24 ore per catturare le nuove capacitàTutte e tre le campagne seguivano lo stesso schema: servizi proxy commerciali per aggirare il blocco geografico della Cina, cluster di account distribuiti per evitare il rilevamento, e prompt strutturati per estrarre capacità specifiche — non le chiacchierate casuali di un utente normale.

Il vero problema: non c’è legge che funzioni

Ed è qui che la questione diventa strutturale. Perché la domanda che tutti si pongono è: “Ma non è illegale?”

La risposta, purtroppo, è molto meno chiara di quanto si vorrebbe.

Il copyright non si applica: L’U.S. Copyright Office ha stabilito che gli output generati dall’AI non raggiungono la soglia di “autorialità umana” necessaria per la protezione. Se le risposte di Claude non sono coperte da copyright, non puoi fare causa per violazione di copyright a chi le usa per addestrare un altro modello.

Paradossalmente, i Terms of Service di OpenAI cedono esplicitamente i diritti sugli output all’utente, rendendo ancora più difficile contestare l’uso che quell’utente ne fa.

I brevetti sono limitati: I brevetti potrebbero coprire architetture specifiche o processi, ma la distillazione non copia l’architettura — copia il comportamento. È come se qualcuno non rubasse il motore della tua Ferrari, ma guidasse la tua auto per migliaia di chilometri per capire esattamente come si comporta, e poi costruisse un’auto diversa che si guida allo stesso modo.

I Terms of Service valgono poco: Certo, Anthropic e OpenAI vietano esplicitamente la distillazione nei loro ToS. Ma provate a far valere un contratto americano contro un’azienda di Hangzhou o Shanghai. La giurisdizione è un muro. E anche se riusciste a portarli in tribunale, il danno è già fatto: il modello distillato è già stato addestrato e distribuito.

Il segreto commerciale è l’unica strada potenziale, ma richiede di dimostrare che l’azienda ha adottato misure ragionevoli per proteggere le informazioni e che c’è stato un accesso non autorizzato.

Quando il tuo prodotto è un’API pubblica e l’accesso avviene attraverso account apparentemente legittimi, la dimostrazione diventa molto complessa.

L’ironia della situazione

C’è un’ironia profonda in tutta questa vicenda, e la community online non ha mancato di farla notare: le stesse aziende che denunciano la distillazione dei loro modelli hanno costruito quei modelli addestrando su enormi quantità di contenuti altrui — libri, articoli, codice, immagini — spesso senza il consenso degli autori originali.

Anthropic stessa è sotto processo da parte degli editori musicali per aver usato testi di canzoni nell’addestramento di Claude.

È il classico “quando lo faccio io è innovazione, quando lo fai tu è furto.”

Questo non giustifica le campagne di distillazione su scala industriale, ma mette in prospettiva la fragilità delle argomentazioni legali: in un ecosistema dove tutti hanno costruito su dati altrui, tracciare una linea netta tra uso legittimo e furto è un esercizio giuridico senza precedenti.

Cosa succederà (probabilmente)

La soluzione non sarà legale, ma tecnica e geopolitica.

Sul fronte tecnico, Anthropic ha annunciato sistemi di behavioral fingerprinting e classificatori per identificare pattern di estrazione.

In pratica: se le tue query assomigliano a una campagna di distillazione e non a un uso normale, vieni bloccato. È una corsa agli armamenti continua, ma è l’unica difesa che funziona in tempo reale. Sul fronte geopolitico, queste denunce rafforzano la narrazione americana a favore di controlli più severi sulle esportazioni di chip AI verso la Cina. Se i modelli cinesi dipendono dalla distillazione di modelli americani per le loro capacità più avanzate, e la distillazione su scala richiede accesso a chip potenti, allora limitare i chip limita (anche) la capacità di distillazione.

La lezione per noi europei

Mentre americani e cinesi si confrontano sui modelli frontier, l’Europa guarda.

E questo è un problema, noi non abbiamo modelli frontier nostri su cui proteggere IP, non abbiamo chip di ultima generazione, non abbiamo le infrastrutture di compute necessarie.

L’AI Act europeo regola l’uso dell’AI ma non la produzione: come se regolassimo le automobili ma non avessimo fabbriche.

Se la distillazione diventa la normalità e l’unica protezione reale è avere qualcosa che valga la pena distillare. E per il momento, quel qualcosa ce l’hanno solo gli americani.

Nota: uso Claude quotidianamente nel mio lavoro e lo considero il miglior modello attualmente disponibile. Questo non cambia il fatto che la questione della distillazione sia oggettivamente complessa e che le ragioni non stiano tutte da una parte.

Lascia un commento