Ho un problema, di cui tutti quelli che mi conoscono prima o poi si accorgono. Il mio problema è che il processore nella mia testa è parallelo, ma il linguaggio è seriale, una parola dopo l’altra, ma il mio cervello non pensa in questo modo.

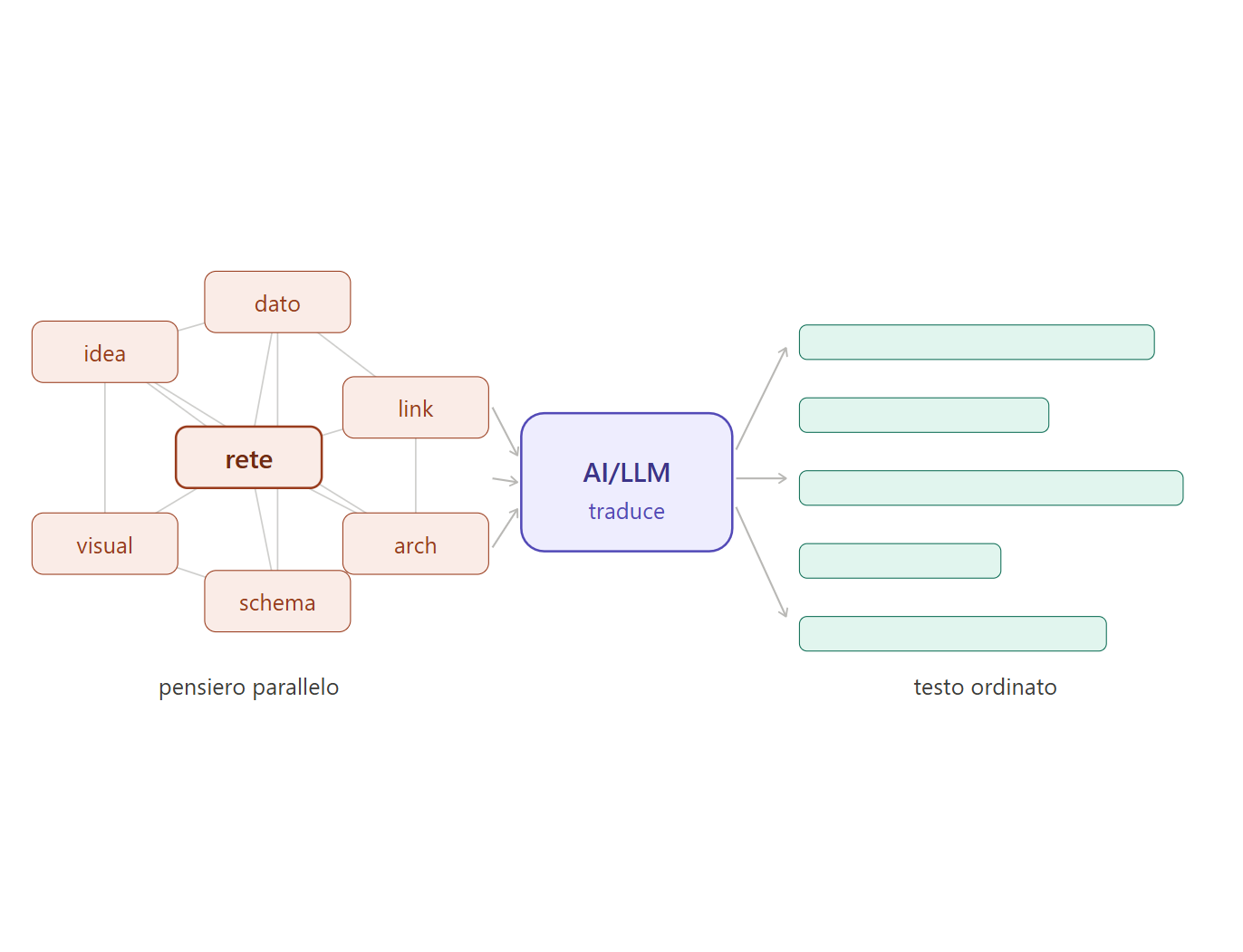

Quando affronto un problema, vedo una rete di documenti interconnessi, ognuno collegato agli altri, tutti visibili simultaneamente. La soluzione è lì, intera, in un lampo.

Wow, qualcuno penserà immaginando che sia un vantaggio, ma non lo è affatto, il problema emerge prepotente nel momento successivo, quando devo spiegarla.

Ed è lì, da quarant’anni, che cominciano i guai. Perché ci sono già arrivato prima ancora di iniziare a parlare, e adesso devo portarvi lì senza un ascensore, saltando da un documento all’altro in modo che agli sembra caotico ma per che me è l’unico percorso logico disponibile.

Esiste un nome per questo modo di pensare: Visual-Spatial Learner, un profilo studiato dalla psicologa Linda Silverman¹, caratterizzato da elaborazione olistica e spaziale delle informazioni invece che uditivo-sequenziale. Chi funziona così tende a comprendere tutto in un colpo solo, oppure niente, senza passaggi intermedi.

Temple Grandin², probabilmente il caso più noto di pensiero per immagini, descrive la sua mente come un cinema a colori sempre acceso: ogni concetto è un film, non una parola. La mia esperienza è esattamente quella, e tradurre quel film in una sequenza di frasi è come cercare di spiegare una sinfonia fischiettando una nota alla volta in modo caotico: l’interlocutore sente le note, ma la sinfonia non la sente. Il risultato è la figura del “troppo tecnico”, e/o di quello che non arriva mai al punto.

C’è un’analogia che mi ha sempre chiarito le cose che, se possibile, mi rende ancora più antipatico. Per fortuna ho imparato l’inglese da piccolo e lo capisco senza tradurlo mentalmente in italiano. Ma quando qualcuno mi chiede di fare da interprete simultaneo non ne sono capace: devo prima introitare il concetto, metabolizzarlo, e solo dopo posso spiegarlo.

La mia compagna, Alessandra è una persona molto paziente. Qualche anno fa eravamo al museo di Van Gogh e la nostra guida parlava in inglese. Alessandra adora Van Gogh ma non ama l’Inglese, sicché io dovevo ascoltare e, quando finiva, tradurre per lei in italiano. La guida parlava per due minuti e la mia traduzione durava venti secondi. Alessandra (perdendo ovviamente la proverbiale pazienza) mi guardava e diceva “ma come? Lei parla due minuti e tu mi dici tutto in venti secondi?”… Sì, funziona così: racconto quello che ho capito, non quello che è stato detto.

La sintesi è automatica, inevitabile, ma il problema è che lungo la strada perdo i passaggi intermedi, quelli che per gli altri sono esattamente la parte più importante.

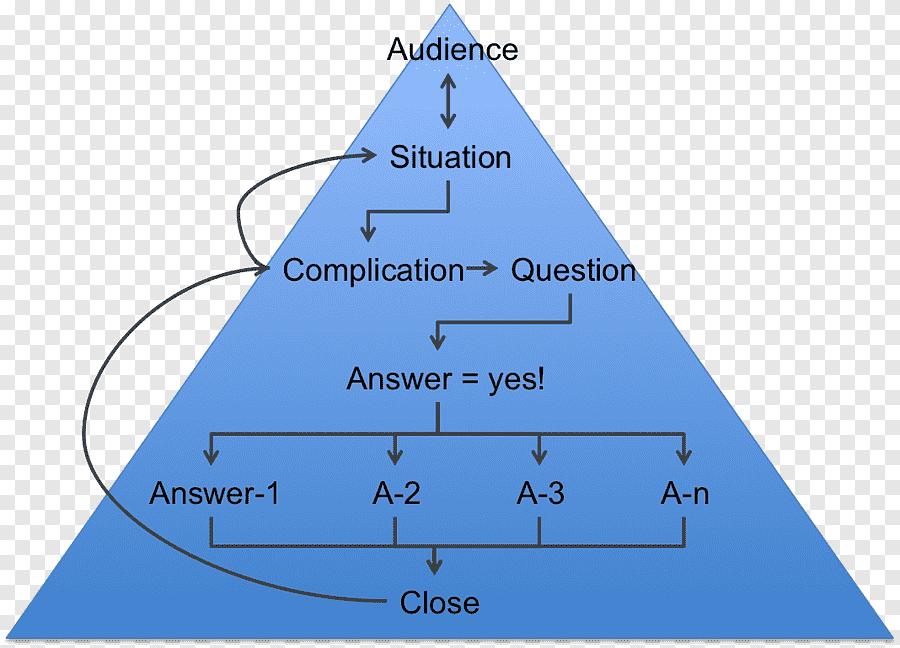

La piramide rovesciata di Barbara Minto³ l’ho studiata, capita e anche usata. Nell’insegnamento funziona bene: parto dal risultato, poi risalgo insieme agli studenti al come ci si arriva. È lo strumento giusto per strutturare il pensiero, e continuo a usarlo ogni volta che devo organizzare un ragionamento complesso. Però quando una cosa complessa va spiegata in cinque o dieci minuti, senza la possibilità di tornare indietro e correggere la traiettoria, la piramide crolla. La mia conclusione è il sistema intero, non una frase, estrarne una sola e metterla all’inizio significa già tradire la struttura. E la struttura, per me, è tutto.

Poi è arrivata l’AI. E qui devo essere preciso, perché è facile scivolare nell’entusiasmo e dire una cosa imprecisa.

L’AI non mi capisce. Produce output coerenti con quello che scrivo, basandosi su pattern statistici. Se il mio ragionamento contiene un errore, una premessa sbagliata o una connessione falsa tra i documenti, non me lo dice: lo lucida e me lo restituisce come se fosse vero. Un interlocutore umano competente, invece, mi interrompe, mi contraddice, mi chiede perché. Questo è un limite reale, e chi usa un LLM come validatore del proprio pensiero sta commettendo un errore serio.

Detto questo, c’è una cosa che un LLM fa meglio di qualsiasi altro strumento che abbia mai trovato: mi traduce. Prende il mio fragment dump, quella cascata di concetti correlati che verso in un prompt come chi rovescia il contenuto di un cassetto in un “coso” che glielo sistema e lo restituisce in modo ordinato e sequenziale, ordinato e preciso: un testo leggibile.

Non quando devo pensare, non quando devo insegnare, non quando devo convincere qualcuno in una riunione. Ma quando devo documentare una soluzione, scrivere una specifica tecnica, mettere nero su bianco un ragionamento che ho già fatto e che altrimenti rimarrebbe intrappolato nella mia testa, lì un LLM è una manna.

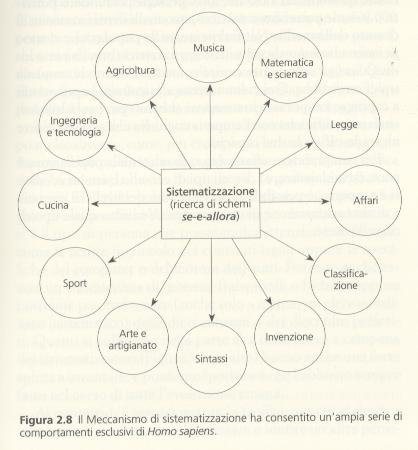

Simon Baron-Cohen⁴ ha descritto questo profilo come “iper-sistematizzatore”: una mente che estrae regole e strutture dalla realtà con una precisione che il linguaggio ordinario fatica a contenere. Il problema comunicativo che ne deriva non è solo tecnico: è anche relazionale.

Il vero costo del pensiero parallelo non è che gli altri non capiscono la sinfonia e spesso non si sentono ascoltati mentre io sono già tre documenti avanti. Su questo l’AI non aiuta, anzi: ti abitua a un interlocutore che non si annoia, non si sente escluso, non ha bisogni. Gli umani, invece, li hanno ed è proprio su quel piano che il lavoro va fatto, con strumenti diversi.

Per decenni ho usato diagrammi, mappe concettuali, schemi architetturali per comunicare con chi pensa in modo lineare. Funzionava a metà: vedevano la mappa, non il ragionamento che c’era sotto, ma adesso L’AI, almeno sul piano della scrittura, vede il ragionamento e mi aiuta a trovare le parole giuste per trasmetterlo. Non è poco. Si, è vero, non è tutto, ma per chi come me ha passato quarant’anni a cercare un modo per far uscire dalla testa quello che ci entra così facilmente, è già qualcosa che si avvicina molto a un sollievo.

La piramide rovesciata per pensare, un LLM per scrivere.

Gli umani per tutto il resto.

P.S. Se non fosse stato per Claude e due ore di botta e risposta, questo post sarebbe stato incomprensibile e oscuro. Grazie Claude!

Note

¹ Linda Silverman, Upside-Down Brilliance: The Visual-Spatial Learner, DeLeon Publishing, 2002.

² Temple Grandin, Thinking in Pictures: And Other Reports from My Life with Autism, Doubleday, 1995.

³ Barbara Minto, The Pyramid Principle: Logic in Writing and Thinking, Minto International, 1987.

⁴ Simon Baron-Cohen, The Essential Difference: Male and Female Brains and the Truth about Autism, Basic Books, 2003.

Lascia un commento