Ieri sera stavo leggendo un articolo su Lucy sulla cultura che parla dell’oblomovismo, quella sindrome tutta russa, dal romanzo di Gončarov del 1859, che descrive una pigrizia metafisica: l’incapacità di agire e di prendere decisioni. Il protagonista, Oblomov, non si alza dal letto per le prime centocinquanta pagine. Non perché sia stupido: ha studiato, ha conosciuto il mondo, si è convinto di potersi rendere utile alla patria. Ma la realtà si è mostrata troppo dura e lui si è ritirato progressivamente. Ha lasciato l’impiego, ha smesso di leggere, e passa le giornate a contorcersi tra le lenzuola.

E mentre leggevo, pensavo a una cosa che vedo ogni settimana.

Parlo con imprenditori, professionisti, gente che manda avanti aziende da vent’anni. Gli chiedo se stanno usando l’AI. Mi rispondono tutti allo stesso modo: “Sì, ho provato ChatGPT, ma non è granché per quello che faccio io.” Poi cambiano discorso. Come Oblomov che riceve i visitatori nel suo letto, un mondano, un impiegato, uno scrittore, ascolta tutti, annuisce, e non si alza.

Ecco il punto: non sono stupidi. Sono Oblomov.

La malattia è sistemica

L’articolo di Lucy racconta una cosa interessante. La critica russa dell’epoca non interpretò l’oblomovismo come un difetto individuale, ma come un tratto nazionale. Il critico Dobroljubov ci scrisse un saggio intero: una malattia congenita dello spirito russo che ostacolava il progresso. Non la pigrizia di uno, ma l’inerzia di tutti.

L’oblomovismo delle aziende italiane di fronte all’AI ha esattamente questa natura. Non è che il singolo imprenditore sia pigro. È che l’intero ecosistema, dalla formazione al rapporto con la tecnologia, dalla burocrazia alla cultura del “abbiamo sempre fatto così”, produce e riproduce torpore. Ognuno si è costruito la sua Oblomovka personale, la tenuta remota dove le regole del mondo esterno non arrivano. Il commercialista che dice “i miei clienti hanno bisogno del rapporto personale”. L’avvocato che dice “il diritto italiano è troppo complesso per una macchina”. Il manifatturiero che dice “noi facciamo cose fisiche, mica software”.

Ognuno ha le sue ragioni. Oblomov aveva le sue.

Quello che sta succedendo, raccontato da chi lo vive

Con grande senso della sincronia un mio amico ieri mi ha inoltrato un post di Matt Shumer, da sei anni alla guida di una startup AI, pubblicato su X che è diventato virale.

Ha scritto che ha smesso di dare la versione educata di quello che sta succedendo.

Il divario tra percezione pubblica e realtà è diventato troppo grande, e troppo pericoloso.

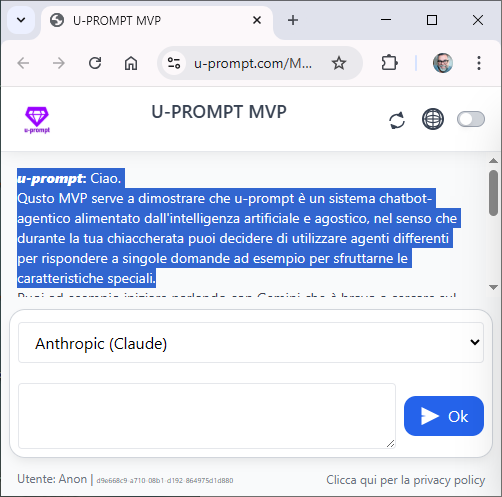

Il passaggio che mi ha colpito di più: Shumer racconta di descrivere un’applicazione in linguaggio naturale, andarsene dal computer per quattro ore, e tornare a trovare il lavoro finito. Non una bozza da correggere, il prodotto completo, migliore di quello che avrebbe fatto lui stesso. L’AI apre l’app, clicca i pulsanti, testa le funzionalità, itera come farebbe uno sviluppatore, e lo avvisa solo quando è soddisfatta del risultato.

Io scrivo codice da prima del Commodore VIC-20, quando avevo un Sinclair ZX81 con 1K di memoria e il BASIC si componeva premendo combinazioni di tasti. Ho certificazioni Microsoft degli anni ’90. So cosa vuol dire debuggare un segfault alle tre di notte. Eppure quello che Shumer descrive è esattamente quello che vivo anche io, ogni giorno, da mesi. Non è hype. Non è marketing. È la mia giornata lavorativa del lunedì.

Ma Shumer dice anche un’altra cosa che merita attenzione. Cita un managing partner di un grande studio legale che passa ore ogni giorno a usare l’AI. Non perché sia un giocattolo, ma perché funziona meglio dei suoi associati su molte attività. E ogni paio di mesi, diventa significativamente più capace. L’organizzazione METR, che misura la durata dei compiti che l’AI può completare autonomamente, un anno fa registrava circa dieci minuti. Oggi siamo a diverse ore. Ha raddoppiato i tempi in soli sette mesi e sta accelerando.

Al meetup di Milano che raccontavo nel mio ultimo post, ho visto un fotografo e un avvocato, nessuna formazione tecnica, costruire applicazioni funzionanti con l’AI. Non vibe coding: architettura, obiettivi, percorso. Competenza di dominio tradotta in prodotto, senza intermediari.

Mentre Oblomov resta a letto.

Il gusto del covo

La cosa che mi ha colpito di più nell’articolo di Lucy è un passaggio su Tommaso Landolfi e quello che chiamava “il senso della lustra”, il gusto del covo. Un piacere voluttuoso di chi si rintana nella propria casa in decadenza, mentre intorno tutto crolla. La casa crolla, sì, ma crolla lentamente, e nel frattempo ci si sta bene.

Questa è l’immagine più precisa che abbia mai trovato per descrivere quello che vedo nelle aziende italiane. L’inerzia non è solo paralisi, è comfort. I margini calano, la competitività si erode, i concorrenti che hanno agito guadagnano velocità e capacità di analisi, ma il covo è caldo. E ci si convince che il proprio settore sia speciale, immune, diverso.

Non lo è. Nessun settore lo è.

Oblomov si innamora di Olga, una donna che potrebbe salvarlo. Ma per sposarla dovrebbe rendersi degno della vita che lei rappresenta, e questo, scrive Gončarov, è una cosa che in pratica non si può fare, per quanto appaia realizzabile in teoria. Così Olga lo lascia e sposa Štolc, il tedesco positivo, il pragmatico. Oblomov riprecipita nel torpore. Sposa una donna che lo accudisce come un bambino. E muore di un colpo apoplettico.

L’azienda che rimanda non esplode. Diventa irrilevante un trimestre alla volta.

Alzarsi dal letto

Non scrivo questo per fare terrorismo psicologico. Lo scrivo perché il vantaggio più grande che potete avere in questo momento è semplicemente essere in anticipo. La finestra è ancora aperta: la maggior parte delle aziende italiane non si è mossa. Chi entra in una riunione e dice “ho usato l’AI per fare questa analisi in un’ora invece che in tre giorni” è la persona più preziosa nella stanza. Non domani, adesso.

Ma la finestra non resterà aperta a lungo.

“Addio vecchia Oblomovka”, dice Štolc alla fine del romanzo, “il tuo tempo è finito.”

Gončarov lo scrive con un pizzico di malinconia, credi che il mercato ne avrà alcuna?

La scelta è semplice, anche se non è facile: alzarsi dal letto, o aspettare il colpo apoplettico.

Photo by RDNE Stock project:

https://www.pexels.com/photo/man-lying-on-sofa-beside-vacuum-5591469/